YOLO11 強勢登場 | AI 物件偵測快到不像話,準確率再創新巔峰!

YOLO11,作為 Ultralytics 推出的最新一代即時物件偵測模型,正掀起電腦視覺領域的新一波革命。它不僅完美承襲了「You Only Look Once」系列與生俱來的極致速度,更在偵測精度、運算效率與多任務支援上實現了全面性的進化。

物件偵測作為電腦視覺的核心基石,其應用遍及工業自動化檢測、自動駕駛、智能監控系統等關鍵領域。在眾多技術方案中,YOLO 系列憑藉其卓越的推論速度與可靠的檢測精度,始終是業界實踐中的首選。近日,Ultralytics 正式推出 YOLO11,這項里程碑式的發布,標誌著即時物件檢測技術邁向了全新的高度。

本文將深入剖析該模型的核心技術創新、具體效能提升以及其在多任務學習上的重大突破,為您全面解讀這一劃時代的模型。

內容

什麼是 YOLO11 ?

該模型是由 Ultralytics 推出的最新一代 You Only Look Once 系列模型,是目前最先進的即時物件偵測(Real-Time Object Detection)架構之一。

它的設計理念延續了 YOLO 系列「一次看全圖」的高效特性,透過單次前向傳播(single forward pass)即可同時完成目標定位與分類,大幅降低運算延遲。

與前代模型相比,該模型在多項關鍵層面上實現了顯著升級:

- 採用更輕量且高效的網路架構,使推論速度再提升。

- 引入改進的特徵融合與注意力機制,提升對細小目標與複雜場景的檢測精度。

- 支援多任務學習(multi-task learning),涵蓋物件偵測、實例分割(instance segmentation)、姿態估計(pose estimation)與分類(classification)等任務。

- 提供多種模型尺寸(如 YOLO11n、s、m、l、x),可依硬體資源與應用場景彈性部署。

總體而言,該模型不僅是一個速度與精度兼具的模型,更是能靈活應對多樣 AI 視覺任務的全方位引擎。

YOLO 的核心運作模式

YOLO(You Only Look Once) 的核心理念在於:「只看一次,就能完成整張影像的物件偵測」。

不同於傳統方法需先產生候選區域(Region Proposals)再進行分類,YOLO 採用**端到端(End-to-End)**的單階段偵測架構,使推論速度遠超過兩階段模型(如 R-CNN、Faster R-CNN)。

其運作流程可概括為以下三個關鍵步驟:

- 影像分格(Grid Division)

YOLO 將輸入影像切分為固定大小的網格(grids),每個格子負責偵測該區域內的物件。 - 邊界框與分類預測(Bounding Box & Class Prediction)

每個格子同時預測多個邊界框(bounding boxes),並對每個框輸出物件類別與置信度(confidence score)。 - 非極大值抑制(Non-Maximum Suppression, NMS)

模型會移除重疊或低置信度的框,保留最有代表性的檢測結果。

這種「單次前向傳播(Single Forward Pass)」的設計,使 YOLO 能在毫秒級完成偵測,真正實現 Real-Time Object Detection(即時物件偵測)。

因此,它在速度與準確度之間取得了理想平衡,也成為邊緣運算與即時應用場景的首選方案。

YOLO 可以做哪些事情?

YOLO 不僅是一個物件偵測模型,也是多功能的 AI 視覺引擎,支援多種任務與應用場景:

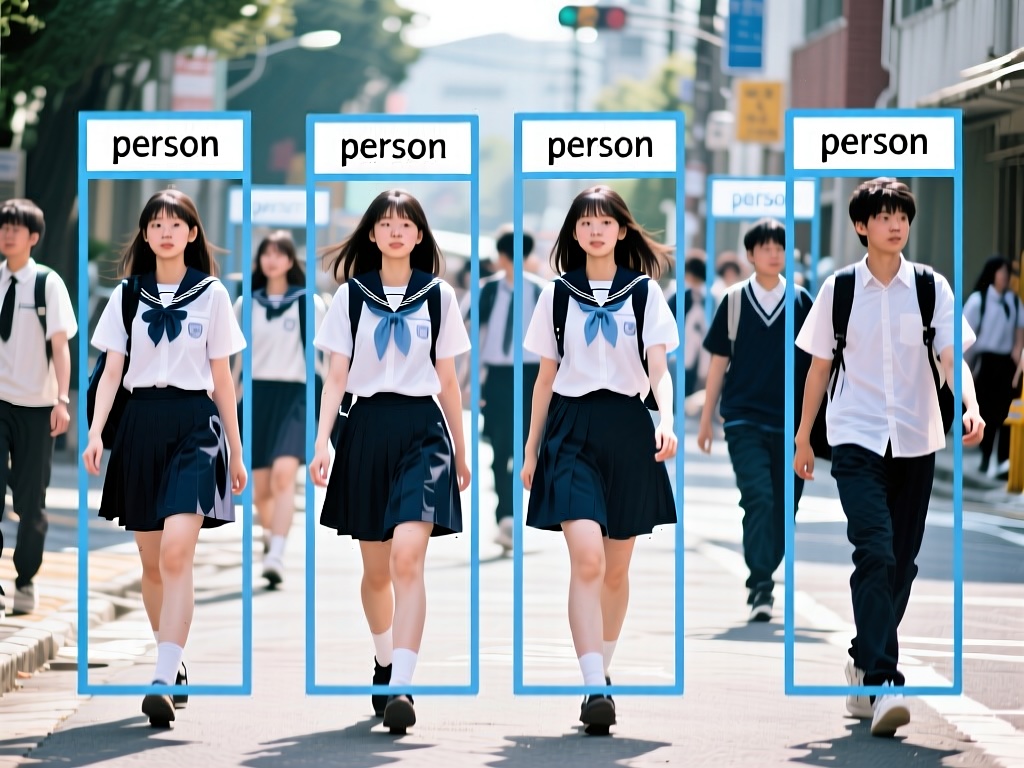

- 即時物件偵測(Real-Time Object Detection): 偵測各類物件,如人、車、動物、工業零件等。適用於監控系統、自駕車、智能工廠等場景

- 實例分割(Instance Segmentation): 不只辨識物件類別,還能精確描繪物件輪廓。適合醫療影像、工業瑕疵檢測、AR/VR 應用

- 姿態估計(Pose Estimation): 偵測人體關鍵點與動作。適合運動分析、行為識別、健身輔助系統

- 分類任務(Classification): 對影像或物件進行分類,支援自訂類別。適用於零售、影像搜尋、品質檢測

- 多任務整合(Multi-Task Learning): 同時處理多種任務,無需分開模型。提升邊緣運算效率與整體部署便利性

開發環境

Ultralytics 提供了官方 Python 套件與命令列工具,只需幾步即可完成環境建置。

系統需求 :

| 項目 | 建議配置 |

|---|---|

| 作業系統 | Windows / macOS / Linux |

| Python 版本 | Python 3.8 以上 |

| GPU 支援 | 建議使用 NVIDIA GPU(CUDA 11+)以加速訓練與推論 |

| 框架依賴 | PyTorch(自動安裝) |

建立 YOLO 虛擬環境

為了保持開發環境乾淨、避免與其他 Python 專案的套件衝突,建議先建立一個專屬的虛擬環境:

python -m venv yoloenv接著啟用環境:

# macOS / Linux

source yoloenv/bin/activate

# Windows

yoloenv\Scripts\activate

當你看到命令列前方出現 (yoloenv) 時,就表示虛擬環境已經啟用成功。

安裝 YOLO 套件

Ultralytics 提供官方的 YOLO 工具包,其中已包含該模型模型與命令列介面。只需一行指令即可安裝:

pip install ultralytics安裝完成後,你可以使用以下指令檢查是否成功:

yolo version若顯示版本號為如 8.3.x,就代表安裝完成 。

Code

在 Python 中執行以下程式碼,如果成功載入模型且沒有報錯,則說明環境基本配置正確。

# ===============================

# YOLO Complete Python Example

# ===============================

import os

from ultralytics import YOLO

# Set up project folder

project_dir = "/Users/kdm4/Desktop/yoloenv/main/outputs" # Customize the save folder

os.makedirs(project_dir, exist_ok=True) # Automatically create if it doesn't exist

# Load YOLO pre-trained model

# This is the nano version – lightweight and fast

model = YOLO("yolo11n.pt")

# Run inference on an image and save results

image_source = "https://ultralytics.com/images/bus.jpg"

results = model(

image_source,

save=True, # Automatically save the output

project=project_dir, # Specify the save location

name="demo", # Subfolder name

)

# Display inference results

results[0].show() # Opens a window showing detection boxes

# Print bounding box details

for i, box in enumerate(results[0].boxes):

cls_id = int(box.cls) # Class index

conf = float(box.conf) # Confidence score

xyxy = box.xyxy[0].tolist() # Bounding box coordinates [x1, y1, x2, y2]

print(f"Object {i+1}: Class {cls_id}, Confidence {conf:.2f}, BBox {xyxy}")

# Show save directory

print(f"Results saved to: {results[0].save_dir}")程式說明

導入套件 :

import os

from ultralytics import YOLOos用來建立資料夾或操作檔案路徑。ultralytics.YOLO是該模型的 Python 模組,用來載入模型、進行推論、管理結果。

設定專案資料夾 :

project_dir = "/Users/kdm4/Desktop/yoloenv/main/outputs"

os.makedirs(project_dir, exist_ok=True)project_dir:指定該模型儲存推論結果的主資料夾。os.makedirs(..., exist_ok=True):如果資料夾不存在會自動建立,避免程式報錯。

載入模型 :

model = YOLO("yolo11n.pt")yolo11n.pt是 YOLO11 nano 版,輕量且快速。- 這行程式會載入模型到 Python,準備進行推論。

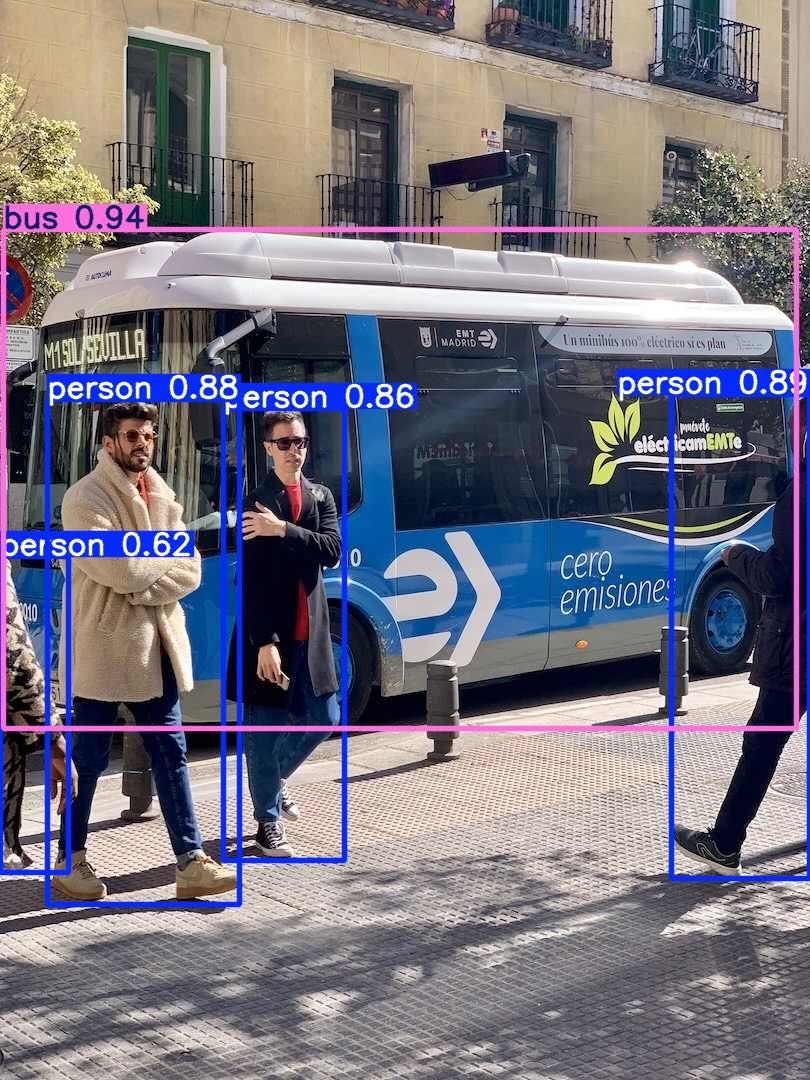

推論圖片並自動儲存 :

results = model(

"https://ultralytics.com/images/bus.jpg",

save=True,

project=project_dir,

name="demo",

)"https://ultralytics.com/images/bus.jpg":推論的圖片,可以是本地檔案或網路圖片。save=True:自動把結果存成帶標註的圖片。project:儲存主資料夾。name:建立子資料夾名稱,避免多次執行覆蓋舊結果。

顯示圖片結果 :

results[0].show()- 打開一個視窗,顯示推論後的圖片,框出偵測到的物件並標示類別與信心分數。

列印偵測框資料 :

for i, box in enumerate(results[0].boxes):

cls_id = int(box.cls)

conf = float(box.conf)

xyxy = box.xyxy[0].tolist()

print(f"Object {i+1}: Class {cls_id}, Confidence {conf:.2f}, BBox {xyxy}")results[0].boxes:所有偵測框的集合,每個物件的詳細資訊都在這裡。cls_id:物件類別編號。conf:模型對該物件的信心分數(0~1)。xyxy:邊界框座標[x1, y1, x2, y2]。- 這段程式會逐一列印每個物件的資訊到終端機。

顯示儲存路徑 :

print(f"Results saved to: {results[0].save_dir}")results[0].save_dir:推論結果儲存的資料夾路徑,方便你打開檢視。

執行後你會看到 :

- 彈出視窗:圖片中所有偵測到的物件都有標註框與類別名稱。

- 終端機輸出:每個偵測物件的類別、信心分數與座標。

- 資料夾結果:

outputs/demo/內會有標註後的圖片,方便保存或分析。

Ultralytics 官方示範影像檔 bus.jpg 結論

YOLO11,不只是 YOLO 系列的進化,更是一場即時物件偵測的革命。

它像是一道閃電,以驚人的速度劃破視覺處理的天空,同時又以鷹眼般的精準鎖定每一個細節。無論是街頭監控、智慧零售,還是自駕車的即時判讀,YOLO 都能在毫秒之間完成辨識,為 AI 應用注入前所未有的效率與可靠性。

更令人驚艷的是,該模型不僅「看得快、看得準」,還能「看得多」——從物件偵測、語義分割、姿態估計,到圖像分類,一個模型就能搞定多種任務,徹底顛覆傳統電腦視覺的工作流程。

對於研究人員,它是探索未來的利器;對於開發者,它是快速落地的橋樑;對於企業,它是智慧轉型的加速器。在這個 AI 高速演進的時代,該模型不只是技術的突破,更是智慧視覺普及化的關鍵一步——讓每一個設備都能「看見」世界,讓每一個應用都能「理解」現實。